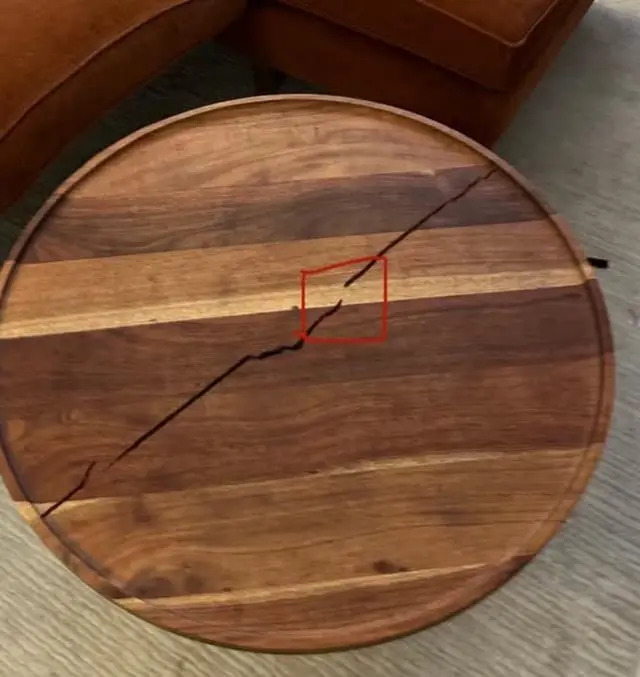

Una viajera londinense reservó un Airbnb en Manhattan y casi terminó con una factura de 16.000 dólares por daños que nunca causó. Las fotos parecían incriminatorias: encimeras agrietadas, muebles manchados, electrodomésticos destrozados. Pero una inspección más detallada reveló incoherencias, bordes deformados, patrones repetidos, señales de que las imágenes habían sido alteradas con IA. La huésped se defendió, demostró que las fotos eran falsas y Airbnb finalmente le devolvió el dinero.

Ese caso fue noticia, pero no es solo un incidente aislado. La industria del alquiler a corto plazo se enfrenta a un aumento de estafas impulsado por la IA generativa. Lo que antes requería habilidades técnicas ahora se puede hacer al instante con herramientas disponibles para todos, haciendo que los anuncios falsos, las fotos manipuladas y las reseñas escritas por IA sean más difíciles de detectar que nunca.

Para los gestores profesionales, esto no solo se trata de huéspedes engañados. Se trata de cómo estas estafas erosionan la confianza, empujan a las plataformas a endurecer sus políticas y elevan el nivel a la hora de demostrar la legitimidad.

Estafas de Airbnb con IA: Cómo funcionan

1. Reclamaciones de daños falseadas

Las herramientas de imagen con IA permiten fabricar “pruebas”. En el caso de Manhattan, las imágenes alteradas casi obligan a una huésped a pagar 16.000 dólares en daños. Este tipo de manipulación muestra cómo las disputas pueden escalar cuando ya no se puede confiar en las imágenes.

Por qué es importante para los gestores: Si los huéspedes adoptan las mismas tácticas, los operadores podrían enfrentarse a reclamaciones fraudulentas, procesos de resolución más largos y mayor exposición a sanciones.

2. Anuncios y reseñas falsos

Los estafadores usan IA para generar fotos realistas de propiedades, crear personajes de anfitrión y producir cientos de reseñas que suenan “auténticas”. Unos pocos clics pueden dar lugar a un anuncio que parece más profesional que el original.

La propia investigación de Airbnb junto con Get Safe Online subraya cuán convincente se ha vuelto este contenido: casi dos tercios de los británicos tienen dificultades para diferenciar imágenes de propiedades generadas por IA de las reales. Más de un tercio confundió imágenes falsas por auténticas y otro cuarto no estaba seguro.

Por qué es importante para los gestores: Las estafas imitadoras pueden dañar la confianza en mercados enteros. Un clon fraudulento de tu propiedad podría circular con reseñas falsas, dificultando aún más que los operadores legítimos consigan reservas.

3. Derivaciones en redes sociales

En Instagram y TikTok, los estafadores publican alquileres brillantes, elaborados con IA y subtítulos de estilo influencer. El objetivo es simple: atraer a viajeros para que paguen fuera de la plataforma, donde no hay protección.

Y los viajeros jóvenes son los más expuestos. La investigación de Airbnb en el Reino Unido muestra:

- El 39% de la Generación Z dice que pagaría por transferencia bancaria si les ahorrara dinero.

- El 43% de la Generación Z reservaría directamente a través de redes sociales.

- Más de un tercio confiaría lo suficiente en la recomendación de una celebridad o influencer como para hacer una reserva costosa.

Por qué es importante para los gestores: Incluso los esfuerzos de marketing auténticos en canales sociales ahora enfrentan mayor escepticismo. Los huéspedes que ya han sido engañados tienden a desconfiar hasta de los anuncios reales.

Cuando la automatización parece una estafa

Un hilo de Reddit señaló recientemente un anuncio en Airbnb como posible estafa con IA porque parecía demasiado perfecto. Los usuarios apuntaron a:

- Fotos de anfitrión al estilo IA

- Respuestas copiadas y pegadas a los huéspedes que parecen guiones de chatbot

- Nombres de empresas sospechosos no vinculados a ubicaciones reales

- Fotos retocadas con logotipos añadidos y “mejoras”

- Anomalías en las reseñas como decenas de valoraciones cinco estrellas en un anuncio recién creado

Aquí está la ironía: algunos de estos rasgos también son signos de profesionalización. Muchos gestores automatizan la mensajería a los huéspedes, mantienen puntuaciones de reseñas consistentes y externalizan la fotografía. Pero en 2025, los huéspedes cada vez más confunden eficiencia con fraude.

Recomendación para los gestores:

- Añade toques personales a los mensajes automatizados.

- Sé transparente sobre la identidad de tu empresa.

- Audita tus anuncios para evitar un tono “robótico”: un exceso de perfección puede levantar sospechas.

Cómo responde Airbnb

Airbnb destaca sus herramientas de detección de fraudes impulsadas por IA:

- Análisis de comportamiento para detectar patrones de reserva incongruentes.

- Puntaje de riesgo para cuentas nuevas que hacen reservas de alto valor.

- Escaneo automatizado en busca de anuncios duplicados o sospechosamente perfectos.

- Campañas de concienciación fomentando reservas seguras y la denuncia de estafas.

Solo en 2024, Airbnb afirma haber detectado y eliminado más de 3.200 dominios de phishing de terceros. Aun así, la carrera continúa. A medida que los estafadores adoptan la IA, Airbnb endurece las reglas y los gestores sienten el efecto dominó. La reciente medida de Vrbo de imponer penalizaciones del 100% por check-ins fallidos es un ejemplo de cómo las OTAs justifican el endurecimiento en nombre de la prevención del fraude.

Más allá de Airbnb: Booking.com registra un aumento del 900% en estafas

El problema abarca todo el sector turístico. La responsable de seguridad en Internet de Booking.com, Marnie Wilking, advirtió en 2024 que las estafas de viajes han aumentado entre un 500 y un 900% en solo 18 meses, en gran parte debido a la IA generativa. Los intentos de phishing, enlaces falsos de reserva y anuncios fraudulentos son mucho más difíciles de detectar, ya que la IA puede generar emails pulidos en varios idiomas e imágenes realistas a gran escala.

“Los atacantes están usando definitivamente la IA para lanzar ataques que imitan emails mucho mejor de lo que han hecho hasta ahora”, dijo Wilking.

Para las plataformas, esto significa entrenar modelos de IA para detectar y eliminar anuncios falsos antes de que lleguen a los huéspedes. Para los gestores, significa que los huéspedes pueden llegar ya escépticos, condicionados por titulares sobre estafas y cautelosos ante ofertas demasiado buenas para ser verdad.

El panorama para los gestores

Para los gestores profesionales de propiedades, las estafas con IA no son solo un problema de los huéspedes. Su impacto se extiende por todo el ecosistema:

- Políticas OTA más estrictas: justificadas como medidas anti-estafa, pero aplicadas de manera amplia.

- Mayor escrutinio: más controles de identidad, más obstáculos de verificación.

- Erosión de la confianza: los huéspedes dudan incluso de anuncios legítimos.

Y el impacto financiero sigue creciendo. La investigación de Airbnb en el Reino Unido concluyó que los viajeros estafados pierden una media de £1.937, cifra que aumenta cada año.

En otras palabras, incluso si sigues todas las reglas, sentirás el impacto.

En resumen

La IA está transformando el panorama de las estafas en los alquileres vacacionales. Para los viajeros, los riesgos son anuncios falsos, fotos manipuladas y engaños fuera de la plataforma. Para los gestores, los riesgos son normas OTA más estrictas, mayores barreras de verificación y una brecha de confianza que la automatización por sí sola no podrá cerrar.

El camino más seguro en 2025 es vigilancia más transparencia: utiliza herramientas de IA para ser eficiente, pero aporta presencia humana para mantener la confianza. Los huéspedes no solo quieren anuncios impecables, quieren la certeza de que detrás hay una persona real.

Uvika Wahi es editora en RSU by PriceLabs, donde lidera la cobertura de noticias y el análisis para gestores profesionales de alquileres a corto plazo. Escribe sobre Airbnb, Booking.com, Vrbo, regulaciones y tendencias del sector, ayudando a los gestores a tomar decisiones empresariales informadas. Uvika también participa como ponente en eventos internacionales de gran relevancia como SCALE, VITUR y el Direct Booking Success Summit.