Une voyageuse londonienne a réservé un Airbnb à Manhattan et a failli se voir réclamer une facture de 16 000 $ pour des dégâts qu’elle n’avait jamais causés. Les photos semblaient accablantes : plans de travail fissurés, meubles tachés, électroménagers brisés. Mais une inspection attentive a révélé des incohérences, des bords déformés, des motifs répétés : autant de signes que les images avaient été modifiées par l’IA. L’hôte de passage a contesté, a prouvé que les photos étaient fausses et Airbnb l’a finalement remboursée.

Ce cas a fait la une des médias, mais il ne s’agit pas d’un incident isolé. Le secteur de la location saisonnière connaît une flambée d’arnaques dopées par l’IA générative. Ce qui exigeait jusqu’ici une expertise technique peut désormais se faire en un instant grâce à des outils accessibles à tous, rendant les fausses annonces, les photos trafiquées et les avis rédigés par IA plus difficiles que jamais à détecter.

Pour les gestionnaires professionnels, il ne s’agit pas seulement d’éviter que les voyageurs se fassent avoir. Les arnaques sapent la confiance, poussent les plateformes à durcir leur politique, et élèvent le niveau d’exigence pour prouver leur légitimité.

Arnaques Airbnb et IA : comment la fraude se développe

1. Réclamations pour dégâts falsifiées

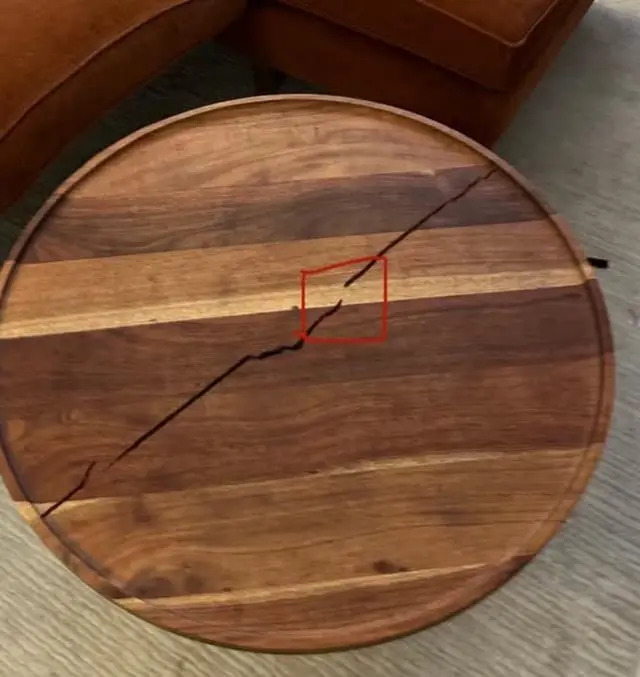

Les outils d’imagerie IA rendent possible la fabrication de « preuves ». Dans l’affaire de Manhattan, des images modifiées ont failli forcer une cliente à payer 16 000 $ de réparations. Ce genre de manipulation montre à quel point les litiges peuvent dégénérer lorsque les images ne sont plus dignes de confiance.

Pourquoi c’est important pour les gestionnaires : Si les voyageurs utilisent les mêmes techniques, les opérateurs pourraient faire face à de fausses réclamations, des délais de résolution allongés et un risque accru de sanctions.

2. Fausse annonces et faux avis

Les fraudeurs utilisent l’IA pour générer des photos immobilières réalistes, créer des identités d’hôtes et produire des centaines de faux avis à l’apparence « authentique ». Quelques frappes de clavier suffisent à créer une annonce plus professionnelle que la plupart des vraies.

La propre étude d’Airbnb menée avec Get Safe Online montre à quel point ce contenu est convaincant : près des deux tiers des Britanniques n’arrivent plus à distinguer les photos générées par IA des vraies. Plus d’un tiers prennent une image fausse pour une authentique et un quart supplémentaire hésitent.

Pourquoi c’est important pour les gestionnaires : Les arnaques de type « copie » portent préjudice à la confiance dans tout un secteur. Un clone frauduleux de votre bien pourrait circuler avec de faux avis, rendant plus difficile la tâche des professionnels légitimes pour décrocher des réservations.

3. Campagnes sur les réseaux sociaux

Sur Instagram et TikTok, des escrocs publient des locations éclatantes créées par IA, associées à des légendes façon influenceur. L’objectif est simple : attirer des voyageurs pour qu’ils paient hors plateforme, où les protections disparaissent.

Et ce sont les jeunes voyageurs qui sont les plus exposés. Les recherches d’Airbnb au Royaume-Uni montrent :

- 39 % de la génération Z accepteraient de payer par virement bancaire si cela leur faisait économiser de l’argent.

- 43 % de la génération Z réserveraient directement via les réseaux sociaux.

- Plus d’un tiers auraient suffisamment confiance dans la recommandation d’une célébrité ou d’un influenceur pour procéder à une réservation d’un montant important.

Pourquoi c’est important pour les gestionnaires : Même les démarches marketing authentiques sur les réseaux sociaux sont maintenant accueillies avec plus de scepticisme. Des voyageurs déjà abusés feront moins confiance, même aux annonces sérieuses.

Quand l’automatisation ressemble à une arnaque

Un fil Reddit a récemment signalé une annonce Airbnb comme potentielle arnaque IA car elle semblait trop parfaite. Les internautes pointaient :

- Photos d’hôte au style IA

- Réponses copiées-collées aux invités qui ressemblent à des scripts de chatbot

- Noms de société suspects sans lien avec des emplacements réels

- Photos trafiquées avec logos ou « améliorations » ajoutées

- Anomalies dans les avis, par exemple des dizaines de notes cinq étoiles pour une annonce toute récente

Voici l’ironie : certains de ces signaux sont aussi des marques de la professionnalisation. Beaucoup de gestionnaires automatisent les messages, maintiennent des notes cohérentes, et externalisent la photographie. Mais en 2025, les voyageurs confondent de plus en plus efficacité et fraude.

Conseils aux gestionnaires :

- Ajoutez une touche personnelle à vos messages automatisés.

- Soyez transparent sur l’identité de votre entreprise.

- Passez en revue vos annonces pour éviter un côté « robotique » : trop de perfection peut susciter la méfiance.

Comment Airbnb riposte

Airbnb met en avant ses outils de détection de fraude pilotés par l’IA :

- Analyse comportementale pour repérer les schémas de réservation incohérents.

- Notation de risque pour les nouveaux comptes faisant des réservations de grande valeur.

- Analyse automatisée pour détecter les doublons ou les annonces « trop parfaites ».

- Campagnes de sensibilisation pour encourager des réservations sûres et le signalement des arnaques.

Rien qu’en 2024, Airbnb dit avoir détecté et supprimé plus de 3 200 domaines de phishing tiers. Pourtant, la lutte continue. Au fur et à mesure que les escrocs adoptent l’IA, Airbnb renforce ses règles, et les gestionnaires en subissent les conséquences. La récente décision de Vrbo d’imposer 100 % de pénalités pour les arrivées non honorées illustre la teneur de ce durcissement au nom de la lutte contre la fraude.

Au-delà d’Airbnb : Booking.com constate une hausse de 900 % des arnaques

Le problème touche tout le secteur du tourisme. Celle qui supervise la cybersécurité chez Booking.com, Marnie Wilking, a averti qu’en 2024, les arnaques liées aux voyages ont augmenté de 500 à 900 % en seulement 18 mois, principalement à cause de l’IA générative. Les tentatives de phishing, faux liens de réservation et fausses annonces sont devenus bien plus difficiles à repérer, car l’IA permet la génération massive d’e-mails multilingues impeccables et d’images ultra-réalistes.

« Les attaquants utilisent sans aucun doute l’IA pour lancer des attaques qui imitent les e-mails bien mieux que ce qu’ils faisaient jusqu’alors », explique Wilking.

Pour les plateformes, cela impose d’entraîner des modèles IA capables de détecter et retirer les fausses annonces avant qu’elles n’atteignent les voyageurs. Pour les gestionnaires, cela signifie que les clients arrivent souvent déjà méfiants, hantés par les gros titres sur les arnaques ou trop bonnes affaires pour être vraies.

L’enjeu pour les gestionnaires

Pour les gestionnaires professionnels, les arnaques à l’IA dépassent le simple problème d’invités escroqués. Elles ont un impact sur tout l’écosystème :

- Durcissement des politiques OTA – justifié au nom de l’anti-fraude, mais appliqué à tous.

- Contrôles renforcés – vérifications d’identité accrues, plus d’étapes de validation.

- Érosion de la confiance – les voyageurs doutent même des annonces légitimes.

L’impact financier ne cesse de croître. Selon une étude d’Airbnb au Royaume-Uni, les voyageurs lésés par une arnaque perdent en moyenne 1 937 £, un chiffre qui augmente chaque année.

Autrement dit, même si vous suivez scrupuleusement les règles, vous en subirez les conséquences.

Conclusion

L’IA transforme le paysage des arnaques dans la location saisonnière. Pour les voyageurs, les risques sont les annonces fictives, les photos truquées et les détournements vers des paiements hors plateforme. Pour les gestionnaires, ce sont le durcissement des règles OTA, la multiplication des obstacles de vérification, et un déficit de confiance que l’automatisation seule ne saurait résoudre.

Le chemin le plus sûr en 2025 : vigilance et transparence. Utilisez l’IA pour l’efficacité, mais conservez une présence humaine pour rassurer. Les clients ne veulent pas seulement d’annonces irréprochables, ils veulent la preuve qu’il y a une vraie personne derrière.

Uvika Wahi est rédactrice chez RSU by PriceLabs, où elle dirige la couverture de l’actualité et l’analyse destinées aux gestionnaires professionnels de locations saisonnières. Elle écrit sur Airbnb, Booking.com, Vrbo, la réglementation et les tendances du secteur, aidant les gestionnaires à prendre des décisions éclairées. Uvika intervient également lors d’événements internationaux majeurs tels que SCALE, VITUR et le Direct Booking Success Summit.